近期,信息學院王菡子教授團隊在跨模態行人重識領域取得重要進展,相關成果以“Adaptive Middle Modality Alignment Learning for Visible-Infrared Person Re-identification”為題發表在CCF A類、國際頂級期刊International Journal of Computer Vision(IJCV)(DOI:10.1007/s11263-024-02276-4)。

在行人重識別領域中,跨模態行人重識別占據著關鍵地位。相較于已被深入探究的傳統行人重識別任務而言,跨模態行人重識別任務因可見光圖像和近紅外圖像之間模態差異顯著而更具難度。這種模態差異源于圖像類型分屬不同光譜,進而致使照明、紋理和顏色等視覺特征存在本質區別,給跨模態匹配與識別工作帶來了阻礙。

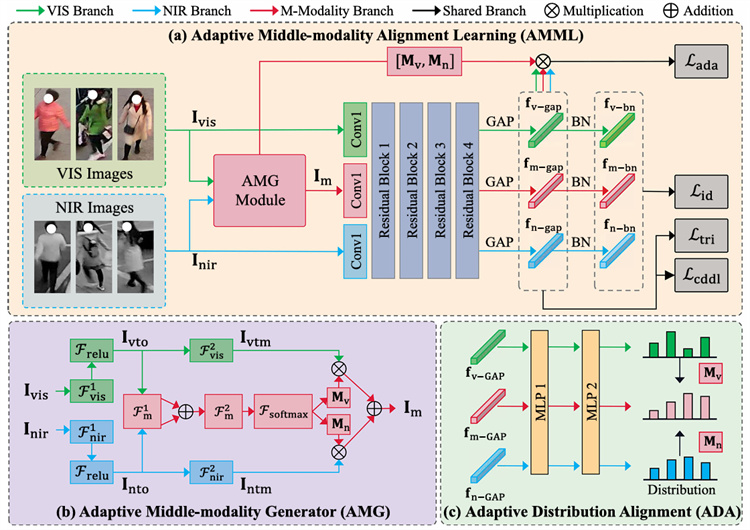

本文聚焦于圖像層面的跨模態行人重識別數據增強方法研究,提出了一種基于自適應模態增強的方法。該方法可以通過自適應中間模態增強學習的策略,分別從圖像層面和特征層面有效地減少跨模態圖像之間的模態差異。如圖1所示,該方法主要包括以下三個組件:首先,該論文提出了一個自適應中間模態生成器模塊,它可以有效地將跨模態圖像投影到統一的中間模態圖像空間中,自適應地生成中間模態圖像,以此從圖像層面減少跨模態圖像之間的模態差異。其次,該論文提出了一種自適應分布對齊損失,旨在促使跨模態特征的分布與中間模態特征的分布自適應地對齊。通過這種方式,所提方法能夠有效地平衡不同模態特征之間的分布差異,進一步提高跨模態行人重識別的性能。此外,該論文還提出了一個中心引導的多樣化特征學習損失,它可以有效地從不同的模態中學習豐富的跨模態知識,同時減少跨模態數據之間的模態差異。本文在具有挑戰性的三個跨模態行人重識別數據集上進行了大量的實驗。實驗結果表明,與現有的跨模態行人重識別方法相比,所提出的方法能夠獲得較好的識別性能(在SYSU-MM01數據集上可以獲得77.8%的Rank-1識別精度和74.8%的mAP識別精度)。

圖1 方法流程圖

IJCV近五年影響因子為14.5。該論文由張玉康博士在王菡子教授、嚴嚴教授、盧楊老師共同指導下完成。該研究工作得到了國家科技創新2030“新一代人工智能”重大項目(2022ZD0160402)、國家自然科學基金聯合基金重點支持項目和面上項目(U21A20514,62372388,62376233)等的支持。